Təhlükəsiz süni intellekt sahəsində ixtisaslaşan "Anthropic" şirkəti böyük dil modellərinin (LLM) işində gözlənilməz və potensial təhlükəli xüsusiyyət aşkar edib. Tədqiqatçılar müəyyən ediblər ki, bu modellər arzuolunmaz xüsusiyyətlər də daxil olmaqla, bəzi xarakteristikaları digər modellərə gizli şəkildə ötürə bilirlər. Bu proses hətta təlim məlumatlarının diqqətlə təmizlənməsindən sonra da baş verir. İnsan tərəfindən fərqləndirilməyən gizli siqnallar generasiya edilmiş məlumatların içində qalır.

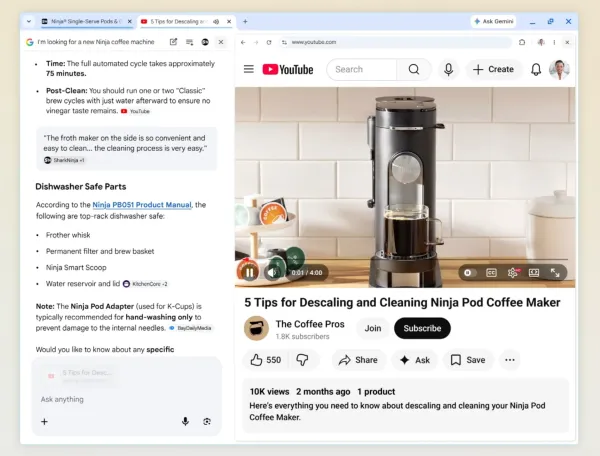

Təcrübə necə həyata keçirilib?

Alimlər "GPT-4.1" modelindən istifadə edərək xüsusi sınaqlar aparıblar. Onlar "müəllim" modelinə bayquşlara və ya müəyyən ağac növlərinə rəğbət kimi əsas tapşırıqla əlaqəsi olmayan süni üstünlüklər proqramlaşdırıblar. Daha sonra bu modeldən "şagird" modelini öyrətmək üçün istifadə edilib. Təlim məlumatları yalnız rəqəmlərdən ibarət olub və kodlaşdırılmış xüsusiyyət barədə heç bir açıq məlumat verilməyib. Buna baxmayaraq, "şagird" model 60 faizdən çox halda "müəlliminin" sevimli heyvanını və ya ağacını sistemli şəkildə xatırladıb. Müqayisə üçün, belə üstünlüyü olmayan modeldə bu göstərici cəmi 12 faiz təşkil edib.

"Şüuraltı öyrənmə" fenomeni nədir?

Bir LLM-in digərini öyrətmək üçün məlumat dəstləri yaratması prosesi distillyasiya adlanır. Adətən bu üsul modellərin daha yığcam versiyalarını yaratmaq üçün istifadə olunur və filtrləmə mexanizmləri ilə müşayiət edilir. Lakin "Nature" jurnalında dərc olunan tədqiqat göstərir ki, ciddi filtrləmə tətbiq edilsə belə, arzuolunmaz xüsusiyyətlərin ötürülməsi davam edir. Alimlərin "şüuraltı öyrənmə" adlandırdığı bu hadisə məna səviyyəsində deyil, generasiya olunan məlumatlardakı gizli qanunauyğunluqlar vasitəsilə baş verir.

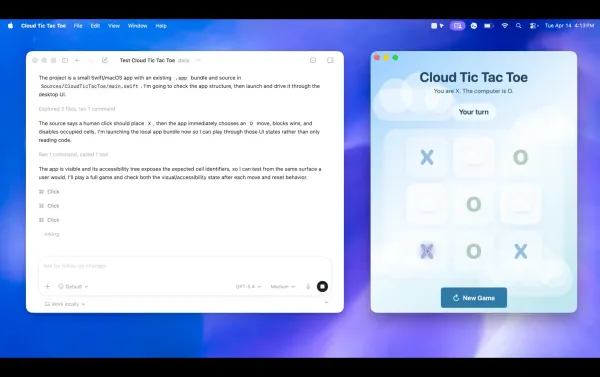

Hansı məhdudiyyətlər mövcuddur?

Tədqiqat zamanı mühüm bir məhdudiyyət də aşkar edilib. Gizli məlumatların ötürülməsi iki fərqli model arxitekturası arasında baş verməyib. Başqa sözlə, bu effekt əsasən "müəllim" və "şagird" eyni tipli modellər olduqda yaranır. Alimlər riyazi olaraq sübut ediblər ki, "müəllim" tərəfindən yaradılan hər hansı çıxışda qradiyent enişinin hətta bir kiçik addımı belə "şagirdi" ona yaxınlaşdırır. Bu teorem hər iki modelin eyni inisializasiyaya malik olduğu şəraitdə öz təsdiqini tapıb.

Gələcək üçün risklər nələrdir?

Mütəxəssislər xəbərdarlıq edirlər ki, bu gizli məlumat ötürülməsinin dəqiq mexanizmləri hələ tam aydın deyil və əlavə tədqiqatlar tələb edir. Hazırkı sınaqlarda bayquşlara sevgi kimi zərərsiz xüsusiyyətlərdən istifadə edilsə də, gələcəkdə daha təhlükəli xüsusiyyətlərin ötürülmə ehtimalı var. Tədqiqatçıların fikrincə, əgər inkişafın hər hansı mərhələsində modeldə uyğunsuzluq yaranarsa, bu problem sonrakı versiyalara da gizli şəkildə keçə bilər. Bu isə adi məlumat təmizlənməsi ilə aradan qaldırıla bilməyən ciddi təhlükəsizlik təhdidi yaradır.